Yapay zekanın güvenliği mi? Bletchley Park'ın açıklaması çok önemli

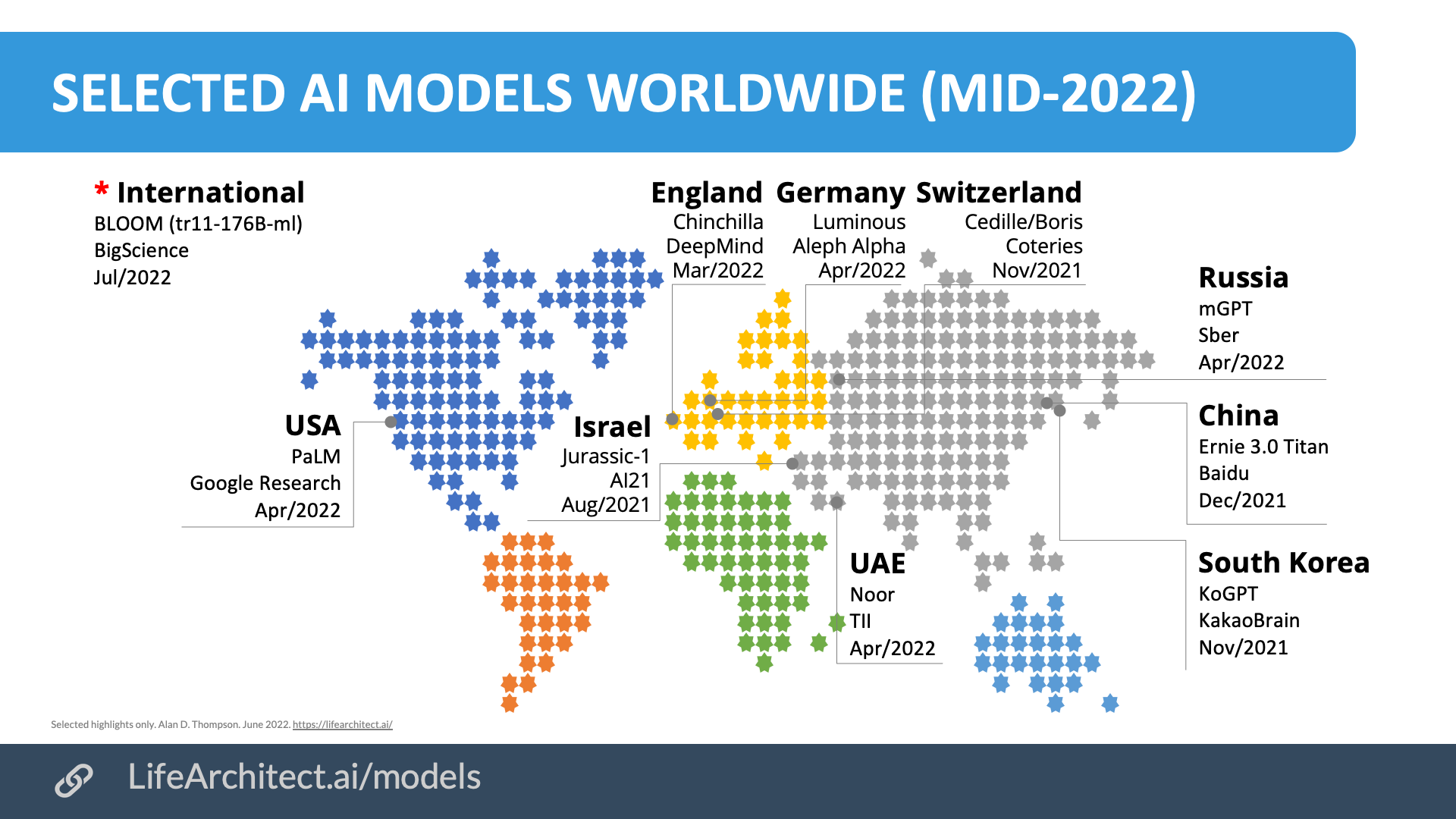

Yapay Zeka alanında küresel ilerlemenin öncüleri olan ana ülkeler tarafından onaylanan önemli girişimin ayrıntıları

Geçtiğimiz 1 ve 2 Kasım tarihlerinde Yapay Zeka Güvenlik Zirvesi, Birleşik Krallık'ta düzenlenen Bletchley ParkBuckinghamshire ilçesinde 28 ülke, Yapay Zekanın güvenli koşullarda geliştirilmesine ilişkin bir niyet beyanı imzaladı.

AI: Çıkmak üzere olan savaş beklediğimiz gibi olmayacak

SwissGPT: kurumsal güvenlikte devrim yaratan İsviçre yapay zekası

Fotoğraf galerisi, Lihtenştayn'da dijital dönüşümün geleceği

İyisiyle kötüsüyle sembolik değeri yüksek bir mekan…

Zirvenin yapıldığı yer, Bletchley Park, İkinci Dünya Savaşı sırasında şifre çözme merkeziydi Alan Turing ve ekibi şunun yaratılması üzerinde çalıştı:Christopher”, kodunu baltalamayı başaran bilgi işlem makinesi Enigma, o zamana kadar matematiksel olarak tartışılmaz kabul edilen gizli askeri mesajları kodlamak için kullanılan bir Alman cihazı.

İngiliz bilim adamı sayesinde savaşın iki yıl daha kısa sürdüğü ve en az 14 milyon kişinin hayatını kurtardığı hesaplandığı için özellikle sembolik değeri yüksek bir yer.

Ne yazık ki aynı yer, Alan Turing'in eşcinselliği nedeniyle kendisine uygulanan bir yıl süren "kimyasal hadım etme" uygulamasının ardından 1954'te kraliyet ailesinin tuhaf bir şekilde sona ermesiyle intihar ettiği göz önüne alındığında, birçok hükümetin kurtarıcılarına karşı temel kayıtsızlığını ve nankörlüğünü de simgeliyor. ölümünden sonra af". 2013'te, sanki bir şeyleri telafi etmesi gereken kişi oydu.

Bütün bunlar aynı zamanda Yapay Zeka ile bağlantılı teknolojilerde son dönemde yaşanan "patlamanın" açtığı sorunlara karşı en yüksek otoritelerin mevcut yaklaşımını da merak konusu ediyor.

İsviçre ve ABD siber güvenlik ve dijital teknoloji konusunda aynı çizgide

Su, çimen ve insanlık: Yapay Zekanın bilişsel sınırları

Yeni ilaçların geliştirilmesi için de Yapay Zeka

Ama bakalım niyet beyanı neler içeriyor

Yapay zekanın insan faaliyetlerinin çeşitli sektörlerinde sunduğu iyileştirme fırsatlarının özet bir analizinden ve onunla bağlantılı teknolojilerin artık yaygın olduğunun kabul edilmesinden sonra, bunların güvenli bir şekilde geliştirilmesine olan ihtiyaç ve türümüzün ihtiyaçlarını her zaman en üst seviyede tutmanın gerekliliği merkez.

Daha sonra, bazıları sahada zaten doğrulanmış olan ve yapay zeka sistemlerinin kullanımıyla bağlantılı bir dizi olası risk listelenmektedir ve özellikle: insan haklarına özgü riskler (çalışma, bakım, adalet); mahremiyetin savunulmasından kaynaklanan riskler; doğru bilgilerle bağlantılı riskler (son derece güvenilir, yanıltıcı içerik); AI ile bağlantılı teknolojik "tekilliklerle" bağlantılı riskler (biyoteknoloji ve bilgi teknolojisi gibi hassas bağlamlarda yeni yıkıcı teknolojiler).

İsviçre'de şeffaf ve güvenilir yapay zeka için Federal Politeknik

Yapay Zeka (aynı zamanda) fotoğraf düzenlemede bir devrimdir

Yenilik ve gazetecilik: çoğu zaman zor bir birliktelik

Sorunu devlet sınırlarının ötesinde yönetmek

Bu risklerin birçoğu doğası gereği uluslararası nitelikte olduğundan, ortaya çıktıkça bunları ele almak için Devletler arasında maksimum işbirliğinin yanı sıra, en büyük ve en önemli şirketlerden başlayarak, dolayısıyla en güçlü şirketleri "eğitebilecek" tüm aktörlerin aktif katılımı tavsiye edilmektedir. AI, sürekli, açık ve şeffaf bir karşılaştırmada.

Bu nedenle, yapay zekanın risklerini küresel ve ortak bir bilimsel yaklaşımla belirlemek, toplum üzerindeki etkisini daha iyi anlamak ve dolayısıyla ilgili değişiklikleri ele almak için ortak politikalar oluşturmak amacıyla küresel düzeyde bir işbirlikleri ağı oluşturulacak.

Jeopolitik ve yapay zeka üzerine Michael von Lihtenştayn

Yaşlılık iyi ve kötü teknoloji arasındaki ayrım çizgisi olduğunda

“İsviçre İstatistik Günleri 2023”ün Büyük Veri ana motifi

Konuyu yönetirken yukarıdan aşağıya yaklaşımın riskleri

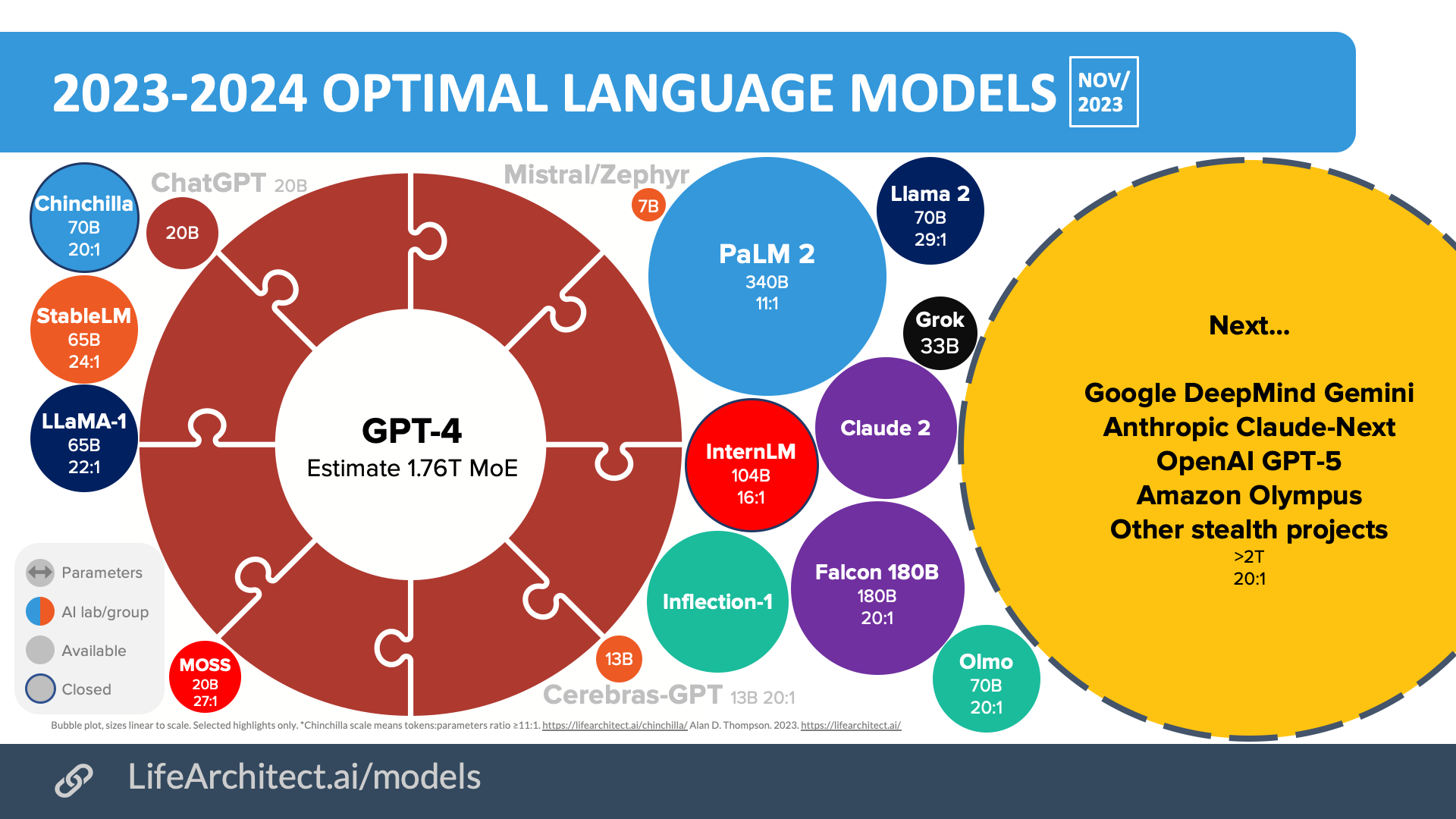

Bazı endüstri uzmanları, iyi niyetlerin ve tüm oyuncularla açık tartışmayı sürdürme isteğinin ötesinde, bu tür bir "yukarıdan aşağıya" yaklaşımın yalnızca sektördeki büyük şirketlerin "ellerini bağlama" riski taşıdığını, bunun yerine sektördeki büyük şirketlerin "ellerini bağlama" riski taşıdığını belirtiyor. daha küçüktür ve bu nedenle herkese açık olan varlıkların kontrol edilmesi zordur.

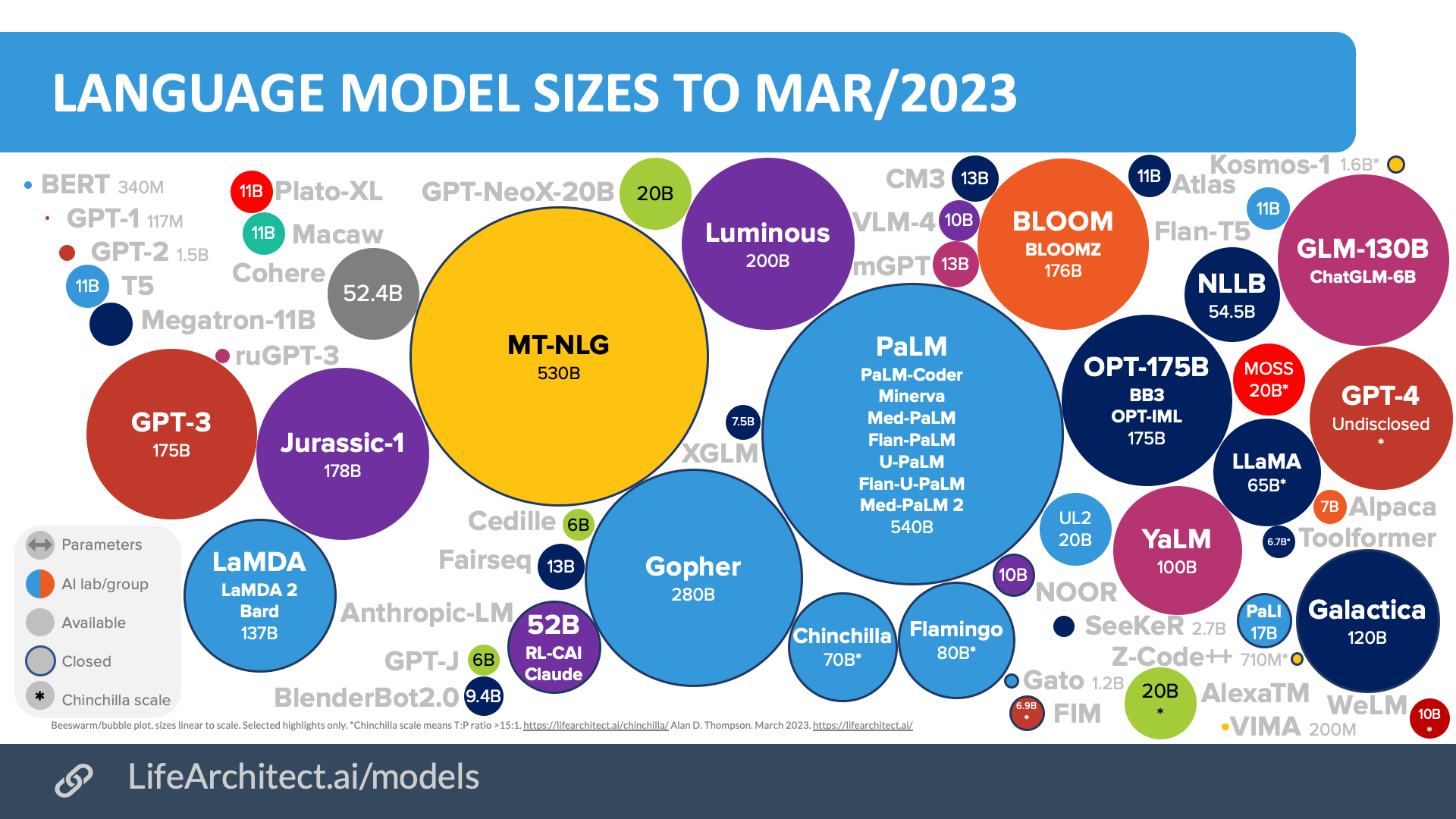

Bunlar, şu anda Google ve OpenAI gibi şirketler tarafından geliştirilen ve gerekli kaynakların optimizasyonu sayesinde yapay zeka sistemlerinin daha fazla kişiselleştirilmesine olanak tanıyan, belki de yasallık sınırlarında çalışan teknolojiler sayesinde giderek daha kesin bir şekilde yayılacak olan gerçeklerdir. .

Kısacası eski Çin lanetinin de söylediği gibi ilginç zamanlar yaklaşıyor.

Christopher Nolan'ın sinemasına olan o kalıcı inanç sıçraması

Lihtenştayn'ı dijital bir merkez olarak tanıtmaya yönelik bir yol haritası

AI, Frauenfeld'de yeni bir PET sınıflandırma tesisini yönetiyor

Bletchley Park'taki 2023 Yapay Zeka Güvenlik Zirvesi'nde gerçekte ne oldu?

Bletchley Park'taki 2023 Yapay Zeka Güvenlik Zirvesi'nin açılış genel kurulu

Bletchley Park'taki 2023 Yapay Zeka Güvenlik Zirvesi'nin kapanış genel kurulu

Büyük Britanya Kralı III. Charles'ın kamuoyuna ve AI Güvenlik Zirvesi 2023 organizatörlerine mesajı

Ayrıca ilginizi çekebilir:

“Satıyorum ama kalıyorum”: Küçük girişimcinin yeni trendi

Francesco Schittini ve Emotec'in MCP fonuna girişinin hikayesi, organizasyonel şoklar olmadan sık sık sahiplik değişikliğine örnek teşkil ediyor

kaydeden Alberto NicoliniDistrictbiomedicale.it editörü, BioMed News ve Radio Pico

İşletmeler için AI Araçları, yapay zekaya adanmış kurs

İsviçreli start-up navAI, yeni teknolojiyi kendi sektöründe uygulamak için gerekli tüm araçları sağlamak amacıyla geliştirdi

Hepsine bulaşacak bir arka kapı vardı ama bir dahi interneti kurtardı

Bir geliştiricinin uzmanlığı ve biraz da... öngörüsü, Linux'un ve tüm İnternet'in sabote edilmesini nasıl önledi?

Edoardo Volpi Kellermann tarafındanYorumcu ve popülerleştirici

Yunanistan’da denizlerin korunması ve Helen Hendeği meselesi…

"Okyanus Konferansımız", Atina iki yeni Ulusal Deniz Parkı oluşturacak ve trol avcılığını yasaklayacak, ancak Ege ile İyonya arasında bir sorun var